Что понимают под информацией в различных отраслях человеческой деятельности

Понятие информации

Урок 1. Информатика 10 класс (ФГОС)

В данный момент вы не можете посмотреть или раздать видеоурок ученикам

Чтобы получить доступ к этому и другим видеоурокам комплекта, вам нужно добавить его в личный кабинет, приобрев в каталоге.

Получите невероятные возможности

Конспект урока «Понятие информации»

· основные философские концепции информации;

· информация в научных сферах.

Если прямо сейчас задать вопрос: «что такое информация?», то можно услышишь множество ответов. Причём каждый ответ будет правильным.

Все эти ответы будут интуитивными и в зависимости от того, с какой сферой деятельности определение свяжут либо в каком контексте будут употреблять. Ответы будут наполнены определённым смыслом. На сегодняшний момент точного определения слова «Информация» нет.

Информация является первичным и неопределяемым в рамках науки понятием. Таких понятий много в разных науках: «буква» в русском языке, «точка» в геометрии, «множество» в математике, «вещество» в химии, «энергия» в физике, «объект» в информатике. О неопределяемых понятиях принято говорить: под понятием “…” будем понимать “…”.

Понятие “информация” для разных сфер человеческой деятельности имеет конкретное значение. Например, в теории информации под «информацией» понимают сведения, уменьшающие неопределённость, или сведения, получаемые и используемые в целях сохранения, совершенствования и развития общественной или технической системы, в документалистике – сведения, зафиксированные на бумаге в виде текста (в знаковой, символьной, графической или табличной форме)

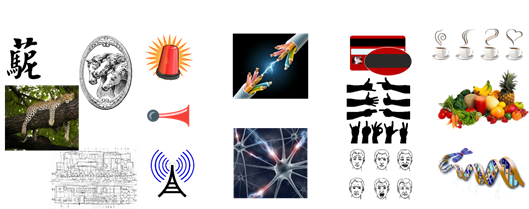

Под информацией мы будем понимать сведения о предметах, событиях, явлениях и процессах окружающего мира. Она представляется и передаётся в форме знаков, рисунков, фотографий, схем; в виде световых или звуковых сигналов; в виде радиоволн; в виде электрических и нервных импульсов; в виде магнитных записей; в виде жестов и мимики; в виде запахов и вкусовых ощущений; в виде хромосом, посредством которых передаются по наследству признаки и свойства организмов.

В курсе школьной информатики понятие информация рассматривается с двух сторон. С точки зрения человека и с точки зрения компьютера.

Информация, с точки зрения, человека – это определённые сведения и знания, которые человек получает из окружающего мира.

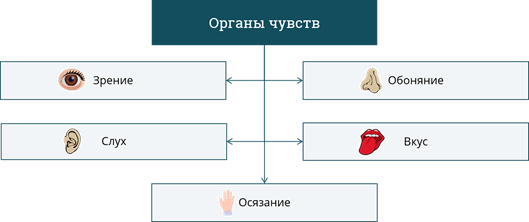

Большая часть сведений, на основании которых формируется представление человека об окружающем мире, поступает к нему благодаря органам чувств.

Всего их пять: зрение, слух, обоняние, вкус, осязание.

Для представления и обмена информацией между людьми служат языки, которые делятся на два вида: естественные, возникшие в результате исторического развития человеческого общества и формальные, созданные искусственно человеком для решения различных задач.

Например, естественные языки – это русский, английский, китайский; а к формальным относятся – азбука Морзе, азбука глухонемых, ноты, языки программирования, языки специализированных областей: химических, физических формул, электротехнические схемы и так далее.

Про информацию можно сказать: новая, старая, актуальная, достоверная, полная, точная, и так далее. К свойствам информации относятся: достоверность; полнота; ценность; своевременность; понятность; доступность; краткость.

Информация (или ресурсы, знания) подразделяется на декларативную (это когда вы говорите: «я знаю, что …), например, я знаю, что Земля вращается вокруг Солнца. И процедурную (это когда вы говорите: «я знаю, как …»). Например, я знаю, как решить задачу.

Если рассматривать информацию с точки зрения компьютера, то необходимо представить информацию в форме понятной для компьютера, в виде битов и двоичных кодов.

Так как компьютер только обрабатывает имеющуюся информацию и не придаёт ей определённого смысла, поэтому правильнее говорить не об информации, а о данных для компьютера. Хотя в обычной жизни мы часто употребляем такие выражения как обработка информации, сохранение информации, это просто устойчивые выражения и вам необходимо помнить, что компьютер работает всё же не с информацией, а с данными.

К видам информации, которые воспринимаются компьютером относятся текстовая, числовая, звуковая, графическая, мультимедийная.

Слово информация происходит от латинского informatio, что означает сведения, разъяснения, изложение. Однако в Толковом словаре Владимира Ивановича Даля нет слова «информация». Так как этот термин начал употребляться с середины двадцатого века.

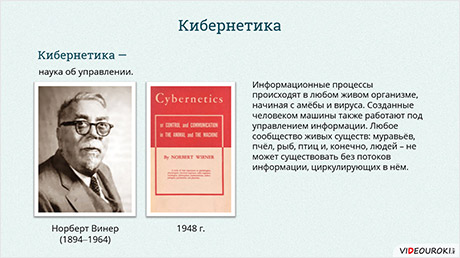

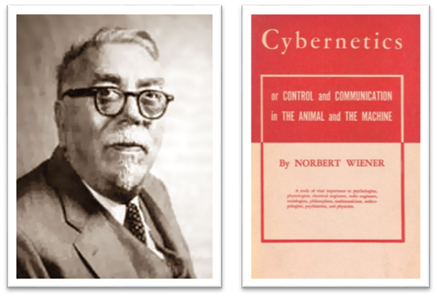

Положение стало меняться с появлением кибернетики – науки об управлении. «Кибернетика» Норберта Винера увидела свет в 1948 году.

Она открыла людям глаза на то, что сейчас известно каждому – информационные процессы происходят в любом живом организме, начиная с амёбы и вируса. Созданные человеком машины также работают под управлением информации. Любое сообщество живых существ – муравьёв, пчёл, рыб, птиц и, конечно, людей не может существовать без потоков информации, циркулирующих в нём.

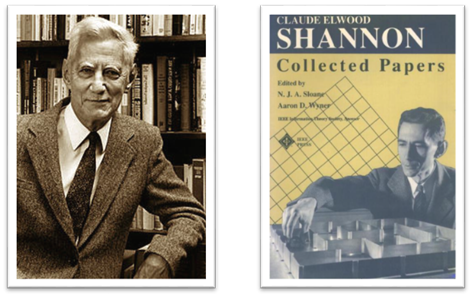

Датой рождения “Теории информации” также считается 1948 год. Именно тогда в реферативном журнале американской телефонной компании «Белл систем» появилась статья 32-летнего инженера-связиста Клода Шеннона «Математическая теория связи”, в которой он предложил способ измерения количества информации. С этого момента понятие «информация» начинает расширять сферу своего применения.

Клод Шенон американский учёный и автор теории связи, разбирая технические системы связи, такие как телеграф, телефон и радио, рассматривал их как системы передачи информации. В таких системах информация передаётся в виде последовательностей сигналов: электрических или электромагнитных.

На современном этапе развития науки стало понятно, что понятие «информация» значительно более ёмкое и, что очень важно, существует и вне нашего восприятия. Другими словами, весь окружающий нас мир, как доступный, так и недоступный нам, всюду имеет информационную структуру.

“Информация” превратилась в необычайно широкое понятие и встала в один ряд с такими философскими категориями, как материя, энергия, пространство и время. Однако единого общепризнанного определения информации не существует до сих пор, более того, это понятие остаётся одним их самых дискуссионных в современной науке. Все мы имеем представление о том, что такое материя, энергия, пространство, время, информация, мы можем описать их свойства, мы можем их измерять, но мы так и не можем пока дать их чёткого научного определения.

Термин информация используется во всех науках. Давайте узнаем, как определяют информацию в нейрофизиологии и генетике.

Нейрофизиология – это раздел биологии, который изучает механизмы нервной деятельности животного и человека. Данная наука моделирует процесс передачи информации в организме. Для передачи информации мозгу, её необходимо преобразовать в электрохимический сигнал, который по нервным волокнам перейдёт к нейронам (нервным клеткам) мозга. Затем мозг посылает эти сигналы мышечным тканям, от чего происходит движение. Как вы можете заметить, данный процесс схож с кибернетической моделью Норберта Винера.

В генетике используется термин наследственной информации. Данная информация заложена в молекулы ДНК. Данная молекула ДНК является определённым кодом, который задаёт работу всего организма: рост, развития, патологии и прочее. Молекулы ДНК передают наследственную информацию от поколения к поколению.

Понятие информация является фундаментальным, это значит, что оно не объясняется через другие понятия. Как и не объясняются такие понятия как вещество, энергия, пространство, время. Осмыслением таких понятий занимается философия.

Рассмотрим три философские теории, объясняющие значение информации.

Первая теория – атрибутивная. Здесь информация является атрибутом или свойством всех материальных объектов. По данной теории информация зародилась одновременно со Вселенной и проявляется в воздействии одних объектов на другие и в изменениях, к которым такие воздействия приводят.

Вторая теория – функциональная. Здесь информация появляется после зарождения жизни, так как может функционировать только в сложных самоорганизующихся системах, а это только живые организмы.

Третья теория – антропоцентрическая. По данной теории информация существует только в человеческом сознании, в человеческом восприятии, то есть работать с информацией может только человек. Причём для работы с информацией, человек создаёт информационную технику и к ней специальные информационные инструменты.

Все три теории абсолютно разные, поэтому делая выбор, помните, что всякая научная теория это всего лишь размышление и догадки о бесконечности мира.

Мы в повседневной жизни употребляем термин информация с точки зрения антропоцентрической теории. Так как мы воспринимаем информацию как обмен сообщениями между людьми. Самый яркий пример, средства массовой информации (СМИ) предназначены для распространения сообщений, новостей среди населения.

Понятие информация является фундаментальным, это значит, что оно не объясняется через другие понятия. Осмыслением их занимается философия.

Философские теории, объясняющие значение информации.

· Атрибутивная концепция: информация — это всеобщее свойство (атрибут) материи.

· Функциональная концепция: информация и информационные процессы присущи только живой природе, являются её функцией.

· Антропоцентрическая концепция: информация и информационные процессы присущи только человеку.

Понятие информации не имеет чёткого определения. Оно получило широкое распространение в результате развития:

· теории связи (Клода Шеннона) Информация — это содержание, заложенное в знаковые (сигнальные) последовательности.

· кибернетики (Норберта Винера) Информация — это содержание сигналов, передаваемых по каналам связи в системах управления.

Лекция на тему «Понятие информации и информатики»

Онлайн-конференция

«Современная профориентация педагогов

и родителей, перспективы рынка труда

и особенности личности подростка»

Свидетельство и скидка на обучение каждому участнику

«Понятие информации и информатики»

Основные понятия информации

Большинство ученых в наши дни отказываются от попыток дать строгое определение информации и считают, что информацию следует рассматривать как первичное, неопределимое понятие подобно множества в математике. Некоторые авторы учебников предлагают следующие определения информации:

Информация – это знания или сведения о ком-либо или о чем-либо.

Информация – это сведения, которые можно собирать, хранить, передавать, обрабатывать, использовать.

Информатика – наука об информации

– это наука о структуре и свойствах информации, способах сбора, обработки и передачи информации

– информатика, изучает технологию сбора, хранения и переработки информации, а компьютер основной инструмент в этой технологии.

Термин информация происходит от латинского слова informatio, что означает сведения, разъяснения, изложение. В настоящее время наука пытается найти общие свойства и закономерности, присущие многогранному понятию информация, но пока это понятие во многом остается интуитивным и получает различные смысловые наполнения в различных отраслях человеческой деятельности:

в быту информацией называют любые данные, сведения, знания, которые кого-либо интересуют. Например, сообщение о каких-либо событиях, о чьей-либо деятельности и т.п.;

В технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов (в этом случае есть источник сообщений, получатель (приемник) сообщений, канал связи);

В кибернетике под информацией понимают ту часть знаний, которая используется для ориентирования, активного действия, управления, т.е. в целях сохранения, совершенствования, развития системы;

В теории информации под информацией понимают сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

Информация – это отражение внешнего мира с помощью знаков или сигналов.

Информационная ценность сообщения заключается в новых сведениях, которые в нем содержатся (в уменьшении незнания).

полнота — свойство информации исчерпывающе (для данного потребителя) характеризовать отображаемый объект или процесс;

актуальность — способность информации соответствовать нуждам потребителя в нужный момент времени;

достоверность — свойство информации не иметь скрытых ошибок. Достоверная информация со временем может стать недостоверной, если устареет и перестанет отражать истинное положение дел;

доступность — свойство информации, характеризующее возможность ее получения данным потребителем;

релевантность — способность информации соответствовать нуждам (запросам) потребителя;

защищенность — свойство, характеризующее невозможность несанкционированного использования или изменения информации;

эргономичность — свойство, характеризующее удобство формы или объема информации с точки зрения данного потребителя.

Информацию следует считать особым видом ресурса, при этом имеется в виду толкование «ресурса» как запаса неких знаний материальных предметов или энергетических, структурных или каких-либо других характеристик предмета. В отличие от ресурсов, связанных с материальными предметами, информационные ресурсы являются неистощимыми и предполагают существенно иные методы воспроизведения и обновления, чем материальные ресурсы.

С этой точки зрения можно рассмотреть такие свойства информации:

Запоминаемость — одно из самых важных свойств. Запоминаемую информацию будем называть макроскопической (имея в виду пространственные масштабы запоминающей ячейки и время запоминания). Именно с макроскопической информацией мы имеем дело в реальной практике.

Передаваемость информации с помощью каналов связи (в том числе с помехами) хорошо исследована в рамках теории информации К.Шеннона. В данном случае имеется в виду несколько иной аспект — способность информации к копированию, т.е. к тому, что она может быть “запомнена” другой макроскопической системой и при этом останется тождественной самой себе. Очевидно, что количество информации не должно возрастать при копировании.

Воспроизводимость информации тесно связана с ее передаваемостью и не является ее независимым базовым свойством. Если передаваемость означает, что не следует считать существенными пространственные отношения между частями системы, между которыми передается информация, то воспроизводимость характеризует неиссякаемость и неистощимость информации, т.е. что при копировании информация остается тождественной самой себе.

Свойство стираемости информации также не является независимым. Оно связано с таким преобразованием информации (передачей), при котором ее количество уменьшается и становится равным нулю.

Данных свойств информации недостаточно для формирования ее меры, так как они относятся к физическому уровню информационных процессов.

Задание: приведите примеры информации:

в неживой природе (например, в геологии или археологии);

в биологических системах (например, из жизни животных и растений);

в технических устройствах (например, телевидение, телеграфные сообщения);

в жизни общества (например, исторические сведения, реклама, средства массовой информации, общение людей).

Информация всегда связана с материальным носителем.

Носителем информации может быть:

любой материальный предмет (бумага, камень и т.д.);

волны различной природы: акустическая (звук), электромагнитная (свет, радиоволна) и т.д.;

вещество в различном состоянии: концентрация молекул в жидком растворе, температура и т.д.

Машинные носители информации: перфоленты, перфокарты, магнитные ленты, и т.д.

Сигнал называется дискретным, если он может принимать лишь конечное число значений в конечном числе моментов времени.

Сигналы, несущие текстовую, символическую информацию, дискретны.

Аналоговые сигналы используют в телефонной связи, радиовещании, телевидении.

Говорить об информации вообще, а не применительно к какому-то ее конкретному виду беспредметно. Классифицировать ее можно:

по способам восприятия (визуальная, тактильная и т.д.);

по форме представления (текстовая, числовая, графическая и т. д.);

по общественному значению (массовая, специальная, личная).

Примеры получения информации :

1) динамик компьютера издает специфический звук, хорошо знакомый Васе, — следовательно, пришло новое сообщение по ICQ;

2) с вертолета пожарной охраны в глубине леса замечен густой дым — обнаружен новый лесной пожар;

3) всевозможные датчики, расположенные в сейсмологически неустойчивом районе, фиксируют изменение обстановки, характерное для приближающегося землетрясения.

Основные направления в информатике: кибернетика, программирование, вычислительная техника, искусственный интеллект, теоретическая информатика, информационные системы. Понятие информатики является относительно новым в лексиконе современного человека. Несмотря на повсеместное употребление, его содержание остается не проясненным до конца в силу своей новизны. Интуитивно ясно, что оно связано с информацией, а также с ее обработкой на компьютерах. Это подтверждается существующей легендой о происхождении данного слова: считается, что оно составлено из двух слов – ИНФОРМАция и автомаТИКА (как средство преобразования информации).

Вследствие широкого распространения компьютеров и информационного бума, который переживает человечество, с азами информатики должен быть знаком всякий грамотный современный человек; вот почему ее преподавание включено в курс средней школы и продолжается в высшей школе.

Основные понятия информатики

Информатика – область человеческой деятельности, связанная с процессами преобразования информации с помощью компьютеров и других средств вычислительной техники. С информатикой часто связывают одно из следующих понятий: это либо совокупность определенных средств преобразования информации, либо фундаментальная наука, либо отрасль производства, либо прикладная дисциплина.

Информатика как совокупность средств преобразования информации включает технические средства (hardware), программные продукты (software), математические методы, модели и типовые алгоритмы (brainware). В состав технических средств входят компьютеры и связанные с ними периферийные устройства (мониторы, клавиатуры, принтеры и плоттеры, модемы и т.д.), линии связи, средства оргтехники и т.п., т.е. те материальные ресурсы, которые обеспечивают преобразование информации, причем главенствующую роль в этом списке играет компьютер. По своей специфике компьютер нацелен на решение очень широкого круга задач по преобразованию информации, при этом выбор конкретной задачи при использовании компьютера определяется программным средством, под управлением которого функционирует компьютер. К программным продуктам относятся операционные системы и их интегрированные оболочки, системы программирования и проектирования программных продуктов, различные прикладные пакеты, такие, как текстовые и графические редакторы, бухгалтерские и издательские системы и т.д. Конкретное применение каждого программного продукта специфично и служит для решения определенного круга задач прикладного или системного характера. Математические методы, модели и типовые алгоритмы являются тем базисом, который положен в основу проектирования и изготовления программного, технического средства или другого объекта в силу исключительной сложности последнего и, как следствие, невозможности умозрительного подхода к созданию.

Перечисленные выше три ресурсных компонента информатики играют разную роль в процессе информатизации общества. Так, совокупность программных и технических средств, имеющихся в том или ином обществе, и позволяет сделать его информационным, когда каждый член общества имеет возможность получить практически любую (исключая, естественно, секретную) интересующую его информацию (такие потребители информации называются конечными пользователями). В то же время, сложность технических и программных систем заставляет использовать имеющиеся технические и программные продукты, а также нужные методы, модели и алгоритмы для проектирования и производства новых и совершенствования старых технических и программных систем. В этом случае можно сказать, что средства преобразования информации используются для производства себе подобных. Тогда их пользователем является специалист в области информатики, а не конечный пользователь.

Информатика как фундаментальная наука занимается разработкой абстрактных методов, моделей и алгоритмов, а также связанных с ними математических теорий. Ее прерогативой является исследование процессов преобразования информации и на основе этих исследований разработка соответствующих теорий, моделей, методов и алгоритмов, которые затем применяются на практике.

Информатика как отрасль производства практически использует результаты исследований фундаментальной науки информатики. В самом деле, широко известны западные фирмы по производству программных продуктов, такие как Microsoft, Lotus, Borland, и технических средств – IBM, Apple, Intel, Hewlett Packard и другие. Помимо производства самих технических и программных средств разрабатываются также и технологии преобразования информации.

Информатика как прикладная дисциплина занимается подготовкой специалистов в области преобразования информации. Она изучает закономерности протекания информационных процессов в конкретных областях и методологии разработки конкретных информационных систем и технологий.

Таким образом, главная функция информатики состоит в разработке методов и средств преобразования информации с использованием компьютера, а также в применении их при реализации технологического процесса преобразования информации.

Приведите примеры информации с указанием ее носителя. Какого типа сигнал передает эту информацию?

Понятие информации

Термин «информация» происходит от латинского слова «informatio», что означает сведения, разъяснения, изложение. Несмотря на широкое распространение этого термина, понятие информации является одним из самых дискуссионных в науке.

В «Большом энциклопедическом словаре» информация определяется как «общенаучное понятие, включающее обмен сведениями между людьми, человеком и автоматом, автоматом и автоматом обмен сигналами в животном и растительном мире; передачу признаков от клетки к клетке, от организма к организму (генетическая информация). В настоящее время наука пытается найти общие свойства и закономерности, присущие многогранному понятию информация, но пока это понятие во многом остается интуитивным и получает различные смысловые наполнения в различных отраслях человеческой деятельности:

· в обиходе информацией называют любые данные или сведения, которые кого-либо интересуют. Например, сообщение о каких-либо событиях, о чьей-либо деятельности и т.п. «Информировать» в этом смысле означает «сообщить нечто, неизвестное раньше»;

· в технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов;

· в кибернетике под информацией понимает ту часть знаний, которая используется для ориентирования, активного действия, управления, т.е. в целях сохранения, совершенствования, развития системы (Н. Винер).

Клод Шеннон, американский учёный, заложивший основы теории информации — науки, изучающей процессы, связанные с передачей, приёмом, преобразованием и хранением информации, — рассматривает информацию как снятую неопределенность наших знаний о чем-то.

Приведем еще несколько определений:

В «Философском энциклопедическом словаре» приводятся четыре значения этого слова:

Современное научное представление об информации очень точно сформулировал Норберт Винер, «отец» кибернетики. А именно:

Информация — это обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств.

Люди обмениваются информацией в форме сообщений. Сообщение — это форма представления информации в виде речи, текстов, жестов, взглядов, изображений, цифровых данных, графиков, таблиц и т.п.

Одно и то же информационное сообщение (статья в газете, объявление, письмо, телеграмма, справка, рассказ, чертёж, радиопередача и т.п.) может содержать разное количество информации для разных людей — в зависимости от их предшествующих знаний, от уровня понимания этого сообщения и интереса к нему.

«Информация – это особая совокупность сведений, первичным источником которых является опыт» (А.А.Красовский, Г.С.Поспелов, 1961г.). Так, сообщение, составленное на японском языке, не несёт никакой новой информации человеку, не знающему этого языка, но может быть высокоинформативным для человека, владеющего японским. Никакой новой информации не содержит и сообщение, изложенное на знакомом языке, если его содержание непонятно или уже известно.

Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем. Без наличия потребителя, хотя бы потенциального, говорить об информации бессмысленно.

Эта точка зрения отражается в таком определении:

Информация – это новые сведения, позволяющие улучшить процессы преобразования вещества, энергии и самой информации.

В случаях, когда говорят об автоматизированной работе с информацией посредством каких-либо технических устройств, обычно в первую очередь интересуются не содержанием сообщения, а тем, сколько символов это сообщение содержит.

Применительно к компьютерной обработке данных под информацией понимают некоторую последовательность символических обозначений (букв, цифр, закодированных графических образов и звуков и т.п.), несущую смысловую нагрузку и представленную в понятном компьютеру виде. Каждый новый символ в такой последовательности символов увеличивает информационный объём сообщения.

После того, как американский ученый и инженер Клод Шеннон в 1948г. опубликовал работу об основах математической теории связи – теории информации, она нашла применение почти во всех областях науки, где играет роль передача информации в самом общем смысле этого слова. Примерно в те же годы появились первые ЭВМ, ставшие позднее универсальным инструментом для обработки информации. Постепенно учение об информации проникло из кибернетики и информатики в физику, химию, биологию, философию, логику и т.д. Понятие «информация» превратилось в фундаментальное понятие науки и рассматривается под различными углами зрения в многочисленных трудах ученых.

Есть ли между всеми определениями какие-либо точки соприкосновения? Имеем ли мы дело с одним или несколькими понятиями?

В первоначальном и наиболее узком смысле информация – атрибут разумных существ, людей. Это какие-либо сведения, данные, факты, которые, будучи получены из опыта, наблюдения или путем размышления, зафиксированы в материальной форме для сообщения другому существу или самому себе. При таком понимании любая информация с неизбежностью содержит два компонента – содержательный и материальный. То есть, во-1-х, она должна быть понятна тем, для кого предназначена (содержательный компонент), во-2-х, представлена на том или ином материальном носителе, например, бумаге (материальный компонент).

Ясно, что одну и ту же информацию можно представить совершенно по-разному (например, на русском или на английском языке) и на разных носителях (в книге, на магнитном диске).

Если оставить в стороне смысловой компонент информации и абстрагироваться от любого конкретного материального ее носителя, то все еще остается нечто, что может быть предметом исследования. Это формальный компонент. Он включает идею кодирования как таковую, т.е. безотносительно к смыслу кодируемого и независимо от физических свойств носителя информации. Формальный компонент принимает во внимание лишь количественные, частотно-вероятные и структурные свойства информации.

Формальные свойства информации можно исследовать математическими методами – так родилась теория информации. Причем, результаты этих исследований равно применимы к любым процессам и явлениям, в том числе и не относящимся к информационным в узком смысле этого слова, лишь бы они обладали формальными свойствами информационных процессов. Поэтому совершенно логично, что сегодня слово «информация» имеет гораздо более широкое значение. Некоторые исследователи даже связывают понятие информации с разнообразием в природе и обществе, с упорядоченностью вообще.

Информация может существовать в виде:

Предметы, процессы, явления материального или нематериального свойства, рассматриваемые с точки зрения их информационных свойств, называются информационными объектами.

С практической точки зрения информация всегда представляется в виде сообщения. Как показано на рисунке 1, информационное сообщение связано с источником сообщения, получателем сообщения и каналом связи.

| |||

| Рис. 1 |

Информация передаётся в форме сообщений от некоторого источника информации к её приёмнику посредством канала связи между ними. Источник посылает передаваемое сообщение, которое кодируется в передаваемый сигнал. Этот сигнал посылается по каналу связи. В результате в приёмнике появляется принимаемый сигнал, который декодируется и становится принимаемым сообщением.

1. Cообщение, содержащее информацию о прогнозе погоды, передаётся приёмнику (телезрителю) от источника — специалиста-метеоролога посредством канала связи — телевизионной передающей аппаратуры и телевизора.

2. Живое существо своими органами чувств (глаз, ухо, кожа, язык и т.д.) воспринимает информацию из внешнего мира, перерабатывает её в определенную последовательность нервных импульсов, передает импульсы по нервным волокнам, хранит в памяти в виде состояния нейронных структур мозга, воспроизводит в виде звуковых сигналов, движений и т.п., использует в процессе своей жизнедеятельности.

Передача информации по каналам связи часто сопровождается воздействием помех, вызывающих искажение и потерю информации.

С понятием информации связаны такие понятия, как сигнал, сообщение и данные.

Сигнал называется непрерывным, если его параметр в заданных пределах может принимать любые промежуточные значения. Сигнал называется дискретным, если его параметр в заданных пределах может принимать отдельные фиксированные значения.

Сообщение — это информация, представленная в определенной форме и предназначенная для передачи.

Данные — это информация, представленная в формализованном виде и предназначенная для обработки ее техническими средствами, например, ЭВМ.

Понятие данные более общее чем информатика, в нем смысловые свойства сообщения как бы отступают на второй план. Когда нет необходимости подчеркнуть разницу между понятиями данные (вся совокупность сведений) и информация (новые полезные сведения) эти слова используют как синонимы.

В соответствии с этим для оценки количества информации используются разные единицы.

При передаче информации важно обратить внимание на то, какое количество информации пройдет через передающую систему. Ведь информацию можно измерить количественно, подсчитать. И поступают при подобных вычислениях самым обычным путем: абстрагируются от смысла сообщения, как отрешаются от конкретности в привычных всем нам арифметических действиях (как от сложения двух яблок и трех яблок переходят к сложению чисел вообще: 2+3).

1.2.2 Свойства информации

К важнейшим свойствам информации относятся:

Адекватность информации может выражаться в трех формах: семантической, синтаксической, прагматической.

Синтаксическая адекватность. Она отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации, надежность и точность преобразования этих кодов и т.п. Информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, так как при этом не имеет значения смысловая сторона. Эта форма способствует восприятию внешних структурных характеристик, т.е. синтаксической стороны информации.

Семантическая (смысловая) адекватность. Эта форма определяет степень соответствия образа объекта и самого объекта. Семантический аспект предполагает учет смыслового содержания информации. На этом уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи. В информатике устанавливаются смысловые связи между кодами представления информации. Эта форма служит для формирования понятий и представлений, выявления смысла, содержания информации и ее обобщения.

Прагматическая (потребительская) адекватность. Она отражает отношение информации и ее потребителя, соответствие информации цели управления, которая на ее основе реализуется. Проявляются прагматические свойства информации только при наличии единства информации (объекта), пользователя и цели управления. Можно сказать, что прагматическая адекватность определяет полезность информации (ценность) для достижения пользователем поставленной цели. С этой точки зрения анализируются потребительские свойства информации. Эта форма адекватности непосредственно связана с практическим использованием информации, с соответствием ее целевой функции деятельности системы.

Информация достоверна, если она отражает истинное положение дел. Недостоверная информация может привести к неправильному пониманию или принятию неправильных решений.

Достоверная информация со временем может стать недостоверной, так как она обладает свойством устаревать, то есть перестаёт отражать истинное положение дел.

Информация полна, если её достаточно для понимания и принятия решений. Как неполная, так и избыточная информация сдерживает принятие решений или может повлечь ошибки.

Точность информации определяется степенью ее близости к реальному состоянию объекта, процесса, явления и т.п. Для информации, отображаемой цифровым кодом, известны четыре классификационных понятия точности:

Ценность информации зависит от того, насколько она важна для решения задачи, а также от того, насколько в дальнейшем она найдёт применение в каких-либо видах деятельности человека.

Только своевременно полученная информация может принести ожидаемую пользу. Одинаково нежелательны как преждевременная подача информации (когда она ещё не может быть усвоена), так и её задержка. Свойство актуальности информации особо важную роль играет в ситуациях, которые очень быстро изменяются, например, торги на фондовой или валютной бирже.

Если ценная и своевременная информация выражена непонятным образом, она может стать бесполезной.

Информация становится понятной, если она выражена языком, на котором говорят те, кому предназначена эта информация.

Информация должна преподноситься в доступной (по уровню восприятия) форме. Поэтому одни и те же вопросы по-разному излагаются в школьных учебниках и научных изданиях.

Информацию по одному и тому же вопросу можно изложить кратко (сжато, без несущественных деталей) или пространно (подробно, многословно). Краткость информации необходима в справочниках, энциклопедиях, учебниках, всевозможных инструкциях.

1.2.1. Информатизация и компьютеризация общества. Информационные ресурсы.

Информатизация общества — организованный социально-экономический и научно-технический процесс создания оптимальных условий для удовлетворения информационных потребностей и реализации прав граждан, органов государственной власти, органов местного самоуправления организаций, общественных объединений на основе формирования и использования информационных ресурсов.

Информатизация общества является одной их закономерностей современного социального прогресса. Этот термин все настойчивее вытесняет широко используемый до недавнего времени термин «компьютеризация общества». При внешней похожести этих понятий они имеют существенные различия.

Компьютеризация общества — массовое внедрение компьютерной техники во все области жизни людей. Основное внимание уделяется развитию и внедрению технической базы компьютеров, обеспечивающих оперативное получение результатов переработки информации и ее накопление.

При информатизации общества основное внимание уделяется комплексу мер, направленных на обеспечение полного использования достоверного, исчерпывающего и своевременного знания во всех видах человеческой деятельности.

Цель информатизации — улучшение качества жизни людей за счет увеличения производительности и облегчения условий их труда.

Таким образом, «информатизация общества» является более широким понятием, чем » компьютеризация общества», и направлена на скорейшее овладение информацией для удовлетворения своих потребностей.

Информатизация — это сложный социальный процесс, связанный со значительными изменениями в образе жизни населения. Он требует серьёзных усилий на многих направлениях, включая ликвидацию компьютерной неграмотности, формирование культуры использования новых информационных технологий и др.

Уровень развития информационного пространства решающим образом влияет на экономику, обороноспособность и политику. От этого уровня в значительной степени зависит поведение людей, формирование общественно-политических движений и социальная стабильность. Целями информатизации во всем мире и, в том числе, в России являются наиболее полное удовлетворение информационных потребностей общества во всех сферах деятельности.

С конца 80-х годов ХХ века стали говорить о переходе от материального общества к информационному. Признаками такого общества являются:

В период перехода к информационному обществу необходимо подготовить человека к быстрому восприятию и обработке больших объемов информации, овладению им современными средствами, методами и технологий работы. Новые условия работы порождают зависимость информированности одного человека от информации, приобретенной другими людьми. Поэтому уже недостаточно уметь самостоятельно осваивать и накапливать информацию, надо научиться такой технологии работы с информацией, когда подготавливаются и принимаются решения на основе коллективного знания. Это говорит о том, что человек должен иметь определенный уровень культуры по обращению с информацией. Для отражения этого факта был введен термин информационная культура.

Информационная культура – умение целенаправленно работать с информацией и использовать для ее получения, обработки и передачи современные технические средства, методы и компьютерные технологии. Информационная культура является продуктом разнообразных творческих способностей человека и проявляется в следующих аспектах:

Информационные ресурсы — это идеи человечества и указания по их реализации, накопленные в форме, позволяющей их воспроизводство.

Это книги, статьи, патенты, диссертации, научно-исследовательская и опытно-конструкторская документация, технические переводы, данные о передовом производственном опыте и др.

Информация – это специфический ресурс. Во-1-х, со временем ее количество не уменьшается, а наоборот увеличивается, причем, информационные ресурсы (в отличие от всех других видов ресурсов — трудовых, энергетических, минеральных и т.д.) тем быстрее растут, чем больше их расходуют.

Появляется возможность накапливать опыт, систематизировать его и таким образом обеспечивать принятие эффективных решений. Во-2-х, информация является одновременно и предметом и продуктом труда. Исходные данные о фактическом состоянии, например, объекта управления – предмет труда, а различные выходные документы, отчеты, справки, аналитические обзоры – продукт труда.

1.2.2. Информационные процессы, технологии и системы

| · создавать; · передавать; · воспринимать; · иcпользовать; · запоминать; · принимать; · копировать; | · формализовать; · распространять; · преобразовывать; · комбинировать; · обрабатывать; · делить на части; · упрощать; | · собирать; · хранить; · искать; · измерять; · разрушать; · и др. · |

Все эти процессы, связанные с определенными операциями над информацией, называются информационными процессами.

Информационные процессы (сбор, обработка и передача информации) всегда играли важную роль в жизни общества. В ходе эволюции человечества просматривается устойчивая тенденция к автоматизации этих процессов.

Сбор информации – это деятельность субъекта, в ходе которой он получает сведения об интересующем его объекте. Сбор информации может производиться или человеком или с помощью технических средств и систем.

Принятую информацию получатель может использовать неоднократно. С этой целью он должен зафиксировать ее на материальном носителе (магнитном диске, фото, кино и др.). Процесс формирования исходного, несистематизированного массива информации называется накоплением информации.

Обработка информации – это упорядоченный процесс ее преобразования в соответствии с алгоритмом решения задачи, получение одних информационных объектов из других информационных объектов путем выполнения некоторых алгоритмов.

Обработка является одной из основных операций, выполняемых над информацией, и главным средством увеличения объёма и разнообразия информации.

Совокупность методов и устройств, используемых людьми для обработки информации, называют информационной технологией.

Средства обработки информации — это всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер — универсальная машина для обработки информации.

Компьютеры обрабатывают информацию путем выполнения некоторых алгоритмов.

Живые организмы и растения обрабатывают информацию с помощью своих органов и систем.

Человечество занималось обработкой информации тысячи лет. Существует мнение, что мир пережил несколько информационных революций.

Первая информационная революция связана с изобретением и освоением человеческого языка, который, точнее устная речь, выделила человека из мира животных. Это позволило человеку хранить, передавать, совершенствовать, увеличивать приобретенную информацию.

Вторая информационная революция заключалась в изобретении письменности. Прежде всего, резко возросли (по сравнению с предыдущим этапом) возможности по хранению информации. Человек получил искусственную внешнюю память. Организация почтовых служб позволила использовать письменность и как средство для передачи информации. Кроме того, возникновение письменности было необходимым условием для начала развития наук (вспомним Древнюю Грецию, например). С этим же этапом, по всей видимости, связано и возникновение понятия натуральное число. Все народы, обладавшие письменностью, владели понятием числа и пользовались той или иной системой счисления.

Все-таки, зафиксированное в письменных текстах знание было ограниченным, и, следовательно, мало доступным. Так было до изобретения книгопечатания.

В настоящее время термин «информационная технология» употребляется в связи с использованием компьютеров для обработки информации. Информационные технологии охватывают всю вычислительную технику и технику связи и, отчасти, — бытовую электронику, телевидение и радиовещание.

Они находят применение в промышленности, торговле, управлении, банковской системе, образовании, здравоохранении, медицине и науке, транспорте и связи, сельском хозяйстве, системе социального обеспечения, служат подспорьем людям различных профессий и домохозяйкам.

Народы развитых стран осознают, что совершенствование информационных технологий представляет самую важную, хотя дорогостоящую и трудную задачу.

В настоящее время создание крупномасштабных информационно-технологических систем является экономически возможным, и это обусловливает появление национальных исследовательских и образовательных программ, призванных стимулировать их разработку.

После решения задачи обработки информации результат должен быть выдан конечным пользователям в требуемом виде. Эта операция реализуется в ходе решения задачи выдачи информации. Выдача информации, как правило, производится с помощью внешних устройств вычислительной техники в виде текстов, таблиц, графиков и т.д.

Стержнем любой информационной технологии является выбор и реализация наиболее рационального информационного процесса, который можно определить как совокупность процедур по преобразованию и обработке информации.

В свою очередь информационной процедурой принято считать совокупность однородных операций, воздействующих определенным образом на информацию. Основными информационными процедурами являются: регистрация, сбор, передача, кодирование, хранение и обработка информации.

Реализация любой задачи конкретного пользователя требует создания системы информационного обслуживания, которую чаще называют информационной системой.

Любая информационная система создается с целью повышения эффективности того или иного вида деятельности. Рост объемов хранимой и обрабатываемой информации объективно обусловил развитие технических средств, необходимых для реализации информационных процедур. Появление ПЭВМ позволило реализовать автоматизированные ИС.

В автоматизированной информационной системе (АИС) ее основные компоненты приводятся в действие автоматическим устройством, алгоритмизация которого поддается математическому описанию.

АИС, как правило, включает в себя следующие компоненты:

языковые средства и правила, используемые для отбора и подготовки информации к вводу в ЭВМ, для отображения картины реального мира в модель данных, для работы пользователя с системой, для предоставления пользователю выдаваемой системой информации;

АИС классифицируются по характеру обрабатываемой информации и целевой функции.

По характеру обрабатываемой информации различают документальные, фактографические и интеллектуальные АИС. В документальных ИС объектами обработки, хранения и поиска являются определенные документы (патенты, законы, статьи, книги и другие информационные материалы). В фактографических ИС хранимая и обрабатываемая информация представляет собой конкретные сведения, факты (параметры и характеристики объектов, сведения технико-экономического характера, результаты измерений, статистические данные и т.д.). в интеллектуальных АИС объектом хранения являются знания в той или иной предметной области.

Целевые функции определяются назначением данной системы. В зависимости от целей, стоящих перед АИС, можно выделить информационно-справочные, управленческие, информационно-расчетные, информационно-логические и экспертные системы. Практически большинство целевых функций не нуждается в раскрытии их назначения и области применения.

Рассмотрим экспертную систему, под которой понимают объединяющую возможность компьютера со знаниями и опытом эксперта в такой форме, что система может предложить разумный совет или осуществить разумное решение поставленной задачи. Дополнительной характеристикой такой системы является ее способность пояснить, по требованию пользователя, ход своих рассуждений в понятной для него форме.

Во всех системах существуют понятные и доступные средства общения пользователя с системой, в том числе и пользователей не специалистов в области вычислительной техники. С помощью этих средств пользователь формулирует свои запросы, вводит их в систему и воспринимает выдаваемую ему информацию.

1.2.3. Количество информации

Количеством информации называют числовую характеристику сигнала, отражающую ту степень неопределенности (неполноту знаний), которая исчезает после получения сообщения в виде данного сигнала. Эту меру неопределенности в теории информации называют энтропией. Если в результате получения сообщения достигается полная ясность в каком-то вопросе, говорят, что была получена полная или исчерпывающая информация и необходимости в получении дополнительной информации нет. И, наоборот, если после получения сообщения неопределенность осталась прежней, значит, информации получено не было (нулевая информация).

Приведенные рассуждения показывают, что между понятиями информация, неопределенность и возможность выбора существует тесная связь. Так, любая неопределенность предполагает возможность выбора, а любая информация, уменьшая неопределенность, уменьшает и возможность выбора. При полной информации выбора нет. Частичная информация уменьшает число вариантов выбора, сокращая тем самым неопределенность.

Возможно ли объективно измерить количество информации? Важнейшим результатом теории информации является следующий вывод: в определенных, весьма широких условиях можно пренебречь качественными особенностями информации, выразить её количество числом, а также сравнить количество информации, содержащейся в различных группах данных.

В настоящее время получили распространение подходы к определению понятия «количество информации», основанные на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле её новизны или, иначе, уменьшения неопределённости наших знаний об объекте. Эти подходы используют математические понятия вероятности и логарифма.

Пример. Человек бросает монету и наблюдает, какой стороной она упадет. Обе стороны монеты равноправны, поэтому одинаково вероятно, что выпадет одна или другая сторона. Такой ситуации приписывается начальная неопределенность, характеризуемая двумя возможностями. После того, как монета упадет, достигается полная ясность и неопределенность исчезает (становится равной нулю).

Рассмотрим систему из двух электрических лампочек, которые независимо друг от друга могут быть включены или выключены. Для такой системы возможны следующие состояния:

Американский инженер Р. Хартли в 1928 г. процесс получения информации рассматривал как выбор одного сообщения из конечного наперёд заданного множества из N равновероятных сообщений, а количество информации I, содержащееся в выбранном сообщении, определял как двоичный логарифм N.

Формула Хартли: I = log2N

Ту же формулу можно представить иначе:

где i— количество информации в битах;

N-число возможных состояний.

Допустим, нужно угадать одно число из набора чисел от единицы до ста. По формуле Хартли можно вычислить, какое количество информации для этого требуется: I = log2100 = 6,644. Таким образом, сообщение о верно угаданном числе содержит количество информации, приблизительно равное 6,644 единицы информации.

Приведем другие примеры равновероятных сообщений:

1. при бросании монеты: «выпала решка», «выпал орел»;

2. на странице книги: «количество букв чётное», «количество букв нечётное».

Определим теперь, являются ли равновероятными сообщения «первой выйдет из дверей здания женщина» и «первым выйдет из дверей здания мужчина». Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно здании идет речь. Если это, например, станция метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины.

Для задач такого рода американский учёный Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

Формула Шеннона:

где pi — вероятность того, что именно i-е сообщение выделено в наборе из N сообщений.

В качестве единицы информации Клод Шеннон предложил принять один бит (англ. bit — binary digit — двоичная цифра).

Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений (типа «орел»—»решка», «чет»—»нечет» и т.п.).

В вычислительной технике битом называют наименьшую «порцию» памяти компьютера, необходимую для хранения одного из двух знаков «0» и «1», используемых для внутримашинного представления данных и команд.

Бит — слишком мелкая единица измерения. На практике чаще применяется более крупная единица — байт, равная восьми битам. Именно восемь битов требуется для того, чтобы закодировать любой из 256 символов алфавита клавиатуры компьютера (256=2 8 ).

Широко используются также ещё более крупные производные единицы информации:

· 1 Килобайт (Кбайт) = 1024 байт = 2 10 байт,

· 1 Мегабайт (Мбайт) = 1024 Кбайт = 2 20 байт,

· 1 Гигабайт (Гбайт) = 1024 Мбайт = 2 30 байт.

В последнее время в связи с увеличением объёмов обрабатываемой информации входят в употребление такие производные единицы, как:

· 1 Терабайт (Тбайт) = 1024 Гбайт = 2 40 байт,

· 1 Петабайт (Пбайт) = 1024 Тбайт = 2 50 байт.

Например, в русском алфавите, если не считать букву ё, количество букв равно 32. тогда 32=2n, откуда n=5 битов. Поэтому каждый символ несет 5 битов информации, а количество информации в сообщении можно подсчитать, умножив количество информации, которое несет один символ, на количество символов. Такой подход к измерению количества информации называют синтаксическим.

Для человека же существенное значение имеют именно смысл передаваемого сообщения и получаемые при этом знания, т.е. на основе смысловой информации вырабатывается и закрепляется соответствие между будущими символами или образами на входе и необходимыми действиями. Высшие животные не могли бы существовать, если бы у них не было достаточного соответствия (как бы смыслового словаря) между разнообразными сигналами ситуаций внешней среды (запах хищника, запах добычи и т.д.) и целесообразными в этих ситуациях действиями. У человека смысловая информация идет на пополнение соответствий не только между внешними сигналами и действиями, но и между понятиями.

Таким образом, общей чертой смысловой информации является то, что она изменяет запас сведений, запас соответствий у получателя информации. Первоначальный (и меняющийся в ходе поступления информации) запас соответствий можно представить себе как некоторый обобщенный словарь или справочник, который Ю.А.Шрейдер предложил называть тезаурусом (греч. «тезаурус» – сокровище; имеются в виду словари, где даны не только значения слов, но и связи между ними). В качестве меры количества смысловой информации естественно взять изменение тезауруса приёмника под действием поступившей информации.

Таким образом, тезаурусная (семантическая) мера, которая связывает смысловые свойства информации со способностью пользователя понимать поступившее сообщение. Количество информации (Ic) в этом случае зависит от смыслового содержания сообщения (S) и тезауруса приёмника (Sp). Характер такой зависимости показан на рис

Рассмотрим 2 предельных случая, когда количество семантической информации (Ic) равно 0. Если тезаурус приёмника слишком беден (Sp=0) количество информации в сообщении равно нулю, т.к. пользователь не понимает поступающие сведения. Например, в сообщении «Это учебник по высшей математике для 1 курса» трехлетний ребенок совсем ничего не поймет, а школьник старших классов уже кое-что выделит. Максимальную информацию, очевидно, извлечет студент того курса, для которого этот учебник предназначен. Любопытно, что по мере дальнейшего расширения тезауруса приёмника воспринимаемая информация начинает уменьшаться. Уже у студента второго курса при чтении учебника для 1 курса изменение тезауруса будет меньше, а для человека, хорошо знающего высшую математику (Sp →

Таким образом, максимальное количество информации приёмник получает при согласовании ее смыслового содержания со своим тезаурусом Sp (Sp = Sp opt), когда поступающие сведения понятны и несут ранее не известные сведения. Количество семантической информации является величиной относительной и зависит от компетентности получателя (пользователя).

Прагматическая мера информации определяет полезность, ценность информации для достижения поставленной цели. В этом случае оценка количества информации основывается на законах теории вероятностей, точнее, определяется через вероятности событий (формула Шеннона). Это и понятно. Сообщение имеет ценность, несет информацию только тогда, когда мы узнаем из него об исходе события, имеющего случайный характер, когда оно в какой-то мере неожиданно.

В экономических системах ценность информации измеряют в тех же единицах, что и целевая функция системы: прибыль, время обработки и принятия решения и т.п.

В системах автоматизированной обработки данных для измерения объемов информации используется синтаксическая мера (байт и его производные). Это объясняется тем, что эти системы организуются в виде хранилищ данных – баз данных, доступ к которым имеют разные пользователи для решения большого спектра задач.

Мы уже говорили, что понятие информации неразрывно с процессом информирования, который предполагает наличие 3 компонент: источник, получатель и канал передачи информации.

Различные количества информации передаются по каналам связи, и количество проходящей через канал информации не может быть больше его пропускной способности. А ее определяют по тому, какое количество информации проходит здесь за единицу времени.

Один из героев романа Жюля Верна «Таинственный остров», журналист Гедеон Спиллет, передавал по телефону главу из Библии, чтобы его конкуренты не могли воспользоваться телефонной связью. В этом случае канал был загружен полностью, а количество информации было равно нулю, ибо абоненту передавались известные для него сведения. Значит, канал работал вхолостую, пропустив строго определенное количество импульсов, ничем их не нагрузив.

А между тем, чем больше информации несет каждый из определенного числа импульсов, тем полнее используется пропускная способность канала. Поэтому нужно разумно кодировать информацию, найти экономный, скупой язык для передачи сообщений.

Информацию «просеивают» самым тщательным образом. В телеграфе часто встречающиеся буквы, сочетания букв, даже целые фразы изображают более коротким набором нулей и единиц, а те, что встречаются реже более длинным. В случае, когда уменьшают длину кодового слова для часто встречающихся символов и увеличивают для редко встречающихся, говорят об эффективном кодировании информации.

1.2.4. Язык, коды, кодирование

Любое сообщение пишется на каком-либо языке. Язык – это форма (способ) общения, форма хранения и передачи знаний, а также средство получения новых знаний, непосредственно связанное с мышлением.

В информатике и информационных технологиях под языком понимают совокупность символов, соглашений, правил, используемых для отображения и передачи информации, средство описания данных и алгоритмов решения задач.

Упорядоченная последовательность символов – это алфавит языка.

Язык – это подмножество А*, которое удовлетворяет двум системам правил: синтаксическим (голубая штриховка) и семантическим (штриховка бордо), причем семантическим правилам могут удовлетворять только те конструкции, которые удовлетворяют синтаксическим правилам.

Пример: ббсе – не удовлетворяет синтаксису русского языка

Петя съел трактор – все синтаксические правила соблюдены, но предложение не удовлетворяет семантике русского языка

Таким образом, знание языка означает

1. Знание его алфавита,

2. Знание синтаксических правил

3. Знание семантических правил

В этом случае вы сможете общаться и будете правильно поняты.

Преобразование конструкций одного языка в последовательность букв другого алфавита называется кодированием.

Если говорить о кодировании, то сначала надо определить, какую конструкцию языка будем рассматривать в качестве символа, т.е. некоторой неделимой конструкции.

Рассмотрим некоторое предложение языка Q. Предложение состоит из слов, которые в свою очередь состоят из букв. Возможны 3 варианта определения символа (неделимой конструкции языка):

1. символ = буква: предложение – последовательность букв алфавита. Такой подход используется при письменной записи.

2. символ = слово. Такое представление предложений используется в стенографии.

3. символ = предложение. Такая ситуация возникает при переводе с одного языка на другой, причем особенно ярко это проявляется при переводе пословиц, шуток, поговорок.

Проблемой кодирования начал заниматься великий немецкий математик Готфрид Вильгельм Лейбниц; он доказал, что минимальное количество букв, необходимое для кодирования любого алфавита, равно 2.

Пример. Русский язык: 33 буквы*2 (прописные, строчные)-2(ъ,ь) + 10 знаков препинания +10 цифр = 84 символа. Обязательным условием правильного кодирования является возможность однозначного преобразования АÛВ. Сколько двоичных символов необходимо, чтобы закодировать один символ русского языка?

| буква | код |

| а | |

| А | |

| б | |

| Б | |

| в | |

| В | |

| … | |

| м | |

| М |

Предположим, надо закодировать слово Мама. Закодируем его: 10011 0 10010 0. Сделайте обратное преобразование (декодирование). Возникают проблемы, т.к. не понятно, где заканчивается одна буква и начинается другая. Основное правило однозначного преобразования из А в В и обратно нарушено, причина – использование кода переменной длины, следовательно необходимо выбрать код одинаковой заранее определенной длины. Какой?

| N – длина кода | Количество букв, которое можно закодировать кодом длины N (=2N) |

| 64 (мало) | |

| 128 (много) |

Вывод: чем меньше букв в алфавите, тем длиннее символ. В русском языке 33 буквы, слова в среднем состоят из 4-6 букв. В японском языке около 3000 иероглифов, в среднем 1 предложение

В вычислительных машинах используется двоичное кодирование информации любого типа: программы, текстовые документы, графические изображения, видеоклипы, звуки и т.д. Удивительно, но все это богатство информации кодируется с помощью всего двух состояний: включено или выключено (единица или ноль). Формирование представления информации называется ее кодированием. В более узком смысле под кодированием понимается переход от исходного представления информации, удобного для восприятия человеком, к представлению, удобному для хранения, передачи и обработки. В этом случае обратный переход к исходному представлению называется декодированием.

При любых видах работы с информацией всегда идет речь о ее представлении в виде определенных символических структур. Наиболее распространены одномерные представления информации, при которых сообщения имеют вид последовательности символов. Так информация представляется в письменных текстах, при передаче по каналам связи, в памяти ЭВМ. Однако широко используется и многомерное представление информации, причем под многомерностью понимается не только расположение элементов информации на плоскости или в пространстве в виде рисунков, схем, графов, объемных макетов и т.п., но и множественность признаков используемых символов, например цвет, размер, вид шрифта в тексте.

Кодирование текста осуществляется с помощью специальных программных кодовых таблиц. Каждому символу латинского и русского алфавита соответствует свое уникальное число. Можно назвать его номером. Для символов латинского алфавита кодовая таблица одинаковая для всех компьютеров и всех операционных систем. Для русского языка это не так. Например, русские тексты, созданные в операционной системе MS DOS нельзя просматривать в операционной системе WINDOWS без специального преобразования. Для стандартизации кодировки был разработан код ASCII (Американский стандартный код для информационного обмена). Это набор восьмибитовых чисел, который жестко определяет 128 символов для латинского алфавита и некоторых специальных символов, а коды от 128 до 255 предназначены для кодирования символов национальных алфавитов других стран, в том числе и России.

Итак, когда на клавиатуре компьютера нажимается какая-либо клавиша, то в оперативную память передается код этой клавиши, а затем с помощью специальной программы передается какому-либо устройству, например видеокарте, которая генерирует поточечное изображение символа на экране монитора. Внешний вид изображения символов на экране также определяется с помощью программы. Такая программа называется драйвером.

Драйвер – это программа-посредник между оборудованием и другими программами.

Таким образом, тексты хранятся на диске или в памяти в виде чисел и программным способом преобразовываются в изображения символов на экране.

1.2.5. Кодирование изображений